新しい出版物

シーダーズ・サイナイ病院とスミット心臓研究所の人工知能(AI)専門家は、100万枚を超える心エコー図(心臓のビデオ超音波画像)とその臨床的解釈のデータセットを作成しました。このデータベースを用いて、心エコー図画像を「解釈」し、主要な指標を評価できる強力な機械学習アルゴリズム「EchoCLIP」を開発しました。

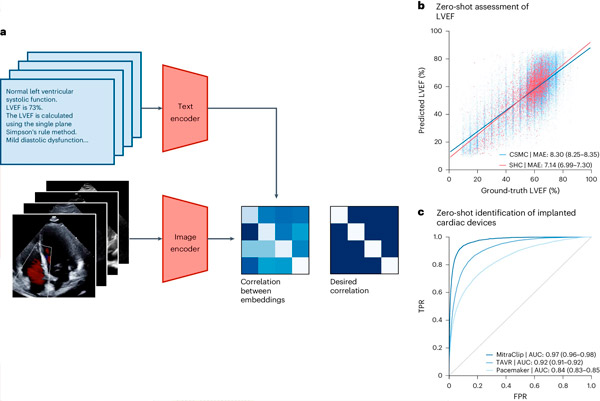

Nature Medicineに掲載された論文に記載されている EchoCLIP の設計と評価によれば、EchoCLIP を使用して患者の心エコー図を解釈すると、心臓機能、過去の手術や埋め込み型デバイスの結果の評価など、専門家レベルの臨床評価が得られ、医師が治療を必要とする患者を特定するのに役立つ可能性があることが示唆されています。

EchoCLIP ベース モデルは、複数のビデオ、研究、および時点にわたって同じ患者を識別し、患者の心臓における臨床的に重要な変化を認識することもできます。

「われわれの知る限り、これは心エコー画像で訓練された最大のモデルだ」と、スミット心臓研究所心臓病部門および医療人工知能部門の教員で、本研究の筆頭著者である医学博士デビッド・オウヤン氏は述べた。

これまでの心エコー図AIモデルの多くは、数万件の例題のみで学習されています。一方、EchoCLIPの画像解釈における比類なき高性能は、既存モデルの約10倍のデータで学習させた結果です。

「私たちの研究結果は、医用画像と専門家が検証した解釈の大規模なデータセットが、生成型人工知能の一形態である基本的な医療モデルの訓練の基礎として役立つことを示している」と欧陽氏は付け加えた。

EchoCLIPワークフロー。出典:Nature Medicine (2024). DOI: 10.1038/s41591-024-02959-y

同氏は、この高度なベースライン モデルは、心臓測定値の推定値の生成、経時的変化や一般的な病気の特定によって、心臓専門医が心エコー図を評価するのに役立つようになるだろうと指摘しました。

研究チームは、EchoCLIPの開発にあたり、1,032,975件の心臓超音波動画とそれに対応する専門家の解釈からなるデータセットを作成しました。本研究の主な知見は以下のとおりです。

- EchoCLIP は心臓画像から心臓機能を評価する上で高い性能を示しました。

- ベースライン モデルは、心エコー画像からペースメーカー、僧帽弁インプラント、大動脈弁インプラントなどの心臓内に埋め込まれたデバイスを識別することができました。

- EchoCLIP は、研究全体にわたって個々の患者を正確に識別し、過去の心臓手術などの臨床的に重要な変化を検出し、心エコー図画像の予備的なテキスト解釈の開発を可能にしました。

「基本モデルは生成AIの最新分野の1つですが、ほとんどのモデルは医療で役立つほど十分な医療データを持っていません」とスミット心臓研究所心臓病部門長のクリスティーナ・M・アルバート医学博士(公衆衛生学修士)は述べています。

この研究には関与していないアルバート氏は、「この新しいベースラインモデルは、心エコー画像解釈のためのコンピュータービジョンと自然言語処理を統合し、心臓専門医の解釈を向上させます」と付け加えた。